”wordCount Java 文本统计“ 的搜索结果

介绍 通过使用三种不同语言编写来编写分词及词频统计程序,比较在大数数据背景下,MapReduce和Spark对三种语言的适应性及其各自的效率对比;项目均采用IDEA+Maven... wordCountJava wordCountPython wordCountScala

spark经典之单词统计准备数据既然要统计单词我们就需要一个包含一定数量的文本,我们这里选择了英文原著《GoneWithTheWind》(《飘》)的文本来做一个数据统计,看看文章中各个单词出现频次如何。为了便于大家下载文本...

1.scSparkContext,Spark程序的入口点,封装了整个spark运行环境的信息。2.进入spark-shell$>spark-shell$scala>scAPI:SparkContextRDD:...spark实现Wordcount//加载文本文件,以换行符方式切割文本。Array(hel...

WordCount程序 首先看来一个快速入门案例,单词计数 这个需求就是类似于我们在学习MapReduce的时候写的案例 需求这样的:读取文件中的所有内容,计算每个单词出现的次数 这个需求就没什么好分析的了,咱们之前在学习...

leetcode算法题主函数如何写文件内容总览src/main/java/wordCountDemo/wordCountDemo.scala是使用scala写的wordcount程序src/main/java/wordcountJava/wordcount.java是使用java写的wordcount程序src/main/java/Api_...

既然要统计单词我们就需要一个包含一定数量的文本,我们这里选择了英文原著《GoneWithTheWind》(《飘》)的文本来做一个数据统计,看看文章中各个单词出现频次如何。为了便于大家下载文本。可以到GitHub上下载文本...

2、作业要求对指定文本内的字符数、单词总数和行数进行统计,且可指定输出至文件,以及一些其它扩展内容。3、将文本内容读取进String中,对该字符串进行检测则可得出结果。4、统计单词个数时,与停用词表中的单词...

一、题目描述实现一个简单而...二、WC 项目要求wc.exe 是一个常见的工具,它能统计文本文件的字符数、单词数和行数。这个项目要求写一个命令行程序,模仿已有wc.exe 的功能,并加以扩充,给出某程序设计语言源文件的...

API [SparkContext] Spark程序的入口点,封装了整个spark运行环境的信息。 代表到Spark集群的连接,可以创建RDD、累加器和广播变量. 每个JVM只能激活一个SparkContext对象,在创建sc之前需要stop掉active的sc。...

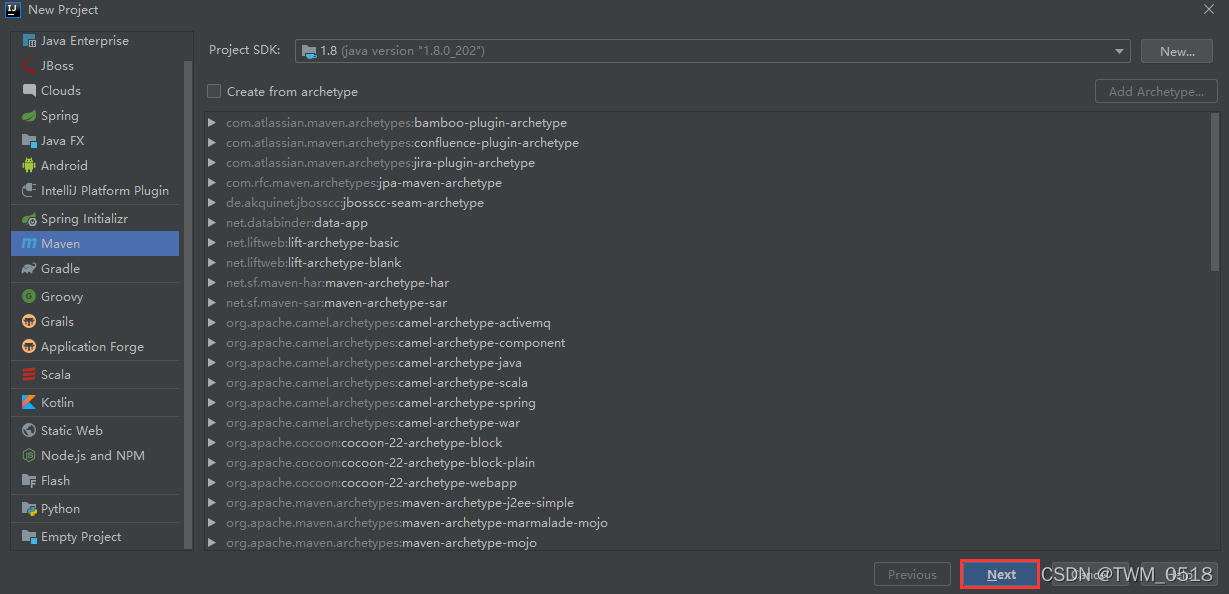

使用Java开发Spark程序 配置Maven环境 使用Java开发WordCount1.png 使用Java开发WordCount2.png 使用Java开发WordCount3.png 使用Java开发WordCount4.png ...dependenc...

Flink练习 一、Flink开发IDEA环境搭建与测试 1、IDEA开发环境 先虚拟机联网,然后执行yum -y install nc nc是用来打开端口的工具 然后nc -l 9000 1.pom文件设置 <properties> ...maven.compiler.source>...

MapReduce概述

标签: mapreduce

几个月前,我很幸运地参加了一些使用Apache Spark的PoC(概念验证)。 在这里,我有机会使用弹性分布式数据集(简称RDD ),转换和操作。 几天后,我意识到虽然Apache Spark和JDK是非常不同的平台,但RDD转换和...

java是hadoop开发的标准官方语言,本文下载了官方的WordCount.java并对其进行了编译和打包,然后使用测试数据运行了该hadoop程序。... 将WordCountjava是hadoop开发的标准官方语言,本文下载了官方的WordCount.jav...

一.IDEA开发环境 1.pom文件设置 <properties> <maven.compiler.source>1.8</maven.compiler.source> <maven.compiler.target>1.8</maven.compiler.target>... ...

Spark的安装及使用 1、官网下载安装Scala:scala-2.12.8.tgz ...tar -zxvf scala-2.12.8.tgz -C /usr/local mv scala-2.12.8 scala 测试:scala -version 启动:scala 2、官网下载安装Spark:spark-2.4.2-bi...

并行 集群计算。 并行计算。 并发 并发执行。 Spark Lightning-fast cluster computing。 快如闪电的集群计算。 大规模快速通用的计算引擎。 速度: 比hadoop 100x,磁盘计算快10x ...运行: Ha...

在windows上实现wordcount单词统计 一、编写scala程序,引入spark类库,完成wordcount 1.sparkcontextAPI sparkcontext是spark功能的主要入口点,代表着到spark集群的连接,可用于在这些集群上创建RDD(弹性...

一.IDEA开发环境 1.pom文件设置 <properties> <maven.compiler.source>1.8</maven.compiler.source> <maven.compiler.target>1.8</maven.compiler.target>... ...

一.IDEA开发环境 1.pom文件设置 <properties> <maven.compiler.source>1.8</maven.compiler.source> <maven.compiler.target>1.8</maven.compiler.target>... &...

并行------------- 集群计算。 并行计算。 并发------------- 并发执行。 Spark------------------------ Lightning-fast cluster computing。 快如闪电的集群计算。 大规模快速通用的计算引擎。...

1.先在d盘建一个test文件夹,里面新建一个文本文档随意输入几个单词 hello world tom hello mading world mading mading asdfasdfasdfasdfasdf 然后保存,再多复制几个这个文件 2.单个文件的词频统计代码 package ...

主要内容使用centos7安装Hadoop并配置(伪分布式)安装前的部署下载Hadoop功能快捷键合理的创建标题,有助于目录的生成如何改变文本的样式插入链接与图片如何插入一段漂亮的代码片生成一个适合你的列表创建一个表格...

并行------------- 集群计算。 并行计算。并发------------- 并发执行。Spark------------------------ Lightning-fast cluster computing。 快如闪电的集群计算。 大规模快速通用的计算引擎。 速度: 比hadoop 100x,...

官网对Spark的介绍 ... Apache Spark™is a unified analytics engine for large-scale data processing Lightning-fast cluster computing。 快如闪电的集群计算。 大规模快速通用的计算引擎。 速度: 比hadoop 100x,...

并行 ------------- 集群计算。 并行计算。 并发 ------------- 并发执行。 Spark ------------------------ Lightning-fast cluster computing。... 速度: 比hadoop 100x,磁盘计算快10x...

一、Storm (一)什么是Storm? Storm为分布式实时计算提供了一组通用原语,可被用于“流处理”之中,实时处理消息并更新数据库。这是管理队列及工作者集群的另一种方式。 Storm也可被用于“连续计算”(continuous...

推荐文章

- Unity3D 导入资源_unity怎么导入压缩包-程序员宅基地

- jqgrid 服务器端验证,javascript – jqgrid服务器端错误消息/验证处理-程序员宅基地

- 白山头讲PV: 用calibre进行layout之间的比对-程序员宅基地

- java exit方法_Java:如何测试调用System.exit()的方法?-程序员宅基地

- 如何在金山云上部署高可用Oracle数据库服务_rman target sys/holyp#ssw0rd2024@gdcamspri auxilia-程序员宅基地

- Spring整合Activemq-程序员宅基地

- 语义分割入门的总结-程序员宅基地

- SpringBoot实践(三十五):JVM信息分析_怎样查看springboot项目的jvm状态-程序员宅基地

- 基于springboot+vue的戒毒所人员管理系统 毕业设计-附源码251514_戒毒所管理系统-程序员宅基地

- 【LeetCode】面试题57 - II. 和为s的连续正数序列_leet code 和为s的正数序列 java-程序员宅基地